21世紀是數字化、網絡化、智能化深入發展的時代,人工智能(AI)作為其中的關鍵技術,其進展備受各界矚目。而過去十年被認為是以深度學習為代表的AI的“黃金十年”。[1]通過深度學習,AI領域的神經網絡技術(Neural Networks)迎來復蘇,讓AI領域迎來飛速發展的“第三個春天”。在這之前,自從1956年達特茅斯會議提出“人工智能”這一概念以來,AI領域已經歷兩起兩落。具體而言,機器學習算法、大數據、云計算、AI專用芯片、開源軟件框架等諸多技術要素的匯聚發展,推動了AI領域取得巨大進展,不僅AI的感知、理解、學習、決策等能力持續得到提高,而且AI因此迅速成為新的通用技術和經濟社會的智能底座,被廣泛應用于經濟社會的各個領域,帶來新的產品和服務。從消費互聯網領域的算法推薦、AI生成內容(AIGC)、聊天機器人,到產業領域的無人駕駛汽車、AI醫療軟件、AI質檢,再到社會公共服務中的各種便民應用,AI對經濟社會高質量發展的巨大價值持續得到彰顯。[2]總之,作為引領新一輪科技革命和產業變革(第四次工業革命)的戰略性技術,AI有望重塑人類經濟社會,對生產力、勞動就業、收入分配、全球化等都將帶來巨大影響。

在此背景下,AI成為國際競爭的新焦點,全球各國紛紛出臺AI發展戰略和具體政策,搶占戰略制高點和發展機遇。2017年7月,中國發布《新一代人工智能發展規劃》,AI上升為國家戰略;2018年4月,歐盟出臺AI戰略,旨在讓歐盟成為世界級的AI中心并確保AI是以人為本的、可信的;2019年2月,《美國AI計劃》發布,啟動AI戰略,旨在提升美國在AI領域的領導地位;2021年9月,英國出臺AI戰略,希望通過十年計劃把英國打造為AI超級大國。分析各國的AI戰略不難看出,AI領域的國際競爭不僅事關技術創新與產業經濟,而且牽涉AI治理等維度。隨著AI的廣泛應用,AI帶來的諸多科技倫理問題持續引起社會各界的高度關注,諸如算法歧視、信息繭房、不公平的AI決策、個人信息濫用和隱私侵犯、AI安全、算法黑箱、責任承擔、技術濫用(如大數據殺熟、AI造假和合成虛假信息)、工作和就業影響、倫理道德沖擊等風險挑戰。[3]因此,伴隨著過去十年AI技術發展應用的“高歌猛進”,國內外各界同步推進AI治理,探索立法、倫理框架、標準和認證、行業最佳做法等多元治理措施和保障機制,支持負責任的、可信的、以人為本的AI發展。

本文立足國際視野,梳理過去十年中國在AI治理領域的重要進展,分析總結其中的規律和趨勢,并展望未來發展。在可預見的未來,隨著AI的能力越來越強,其應用和影響將日益加深,因此,負責任的AI(Responsible AI)將變得越來越重要。而負責任的AI的推進和落實,離不開合理有效的AI治理。換句話說,建立健全AI治理,是邁向負責任AI、保障AI未來發展的必由之路。希冀本文對未來AI治理的持續開展和落地有所助益

AI治理的八個趨勢

宏觀戰略與落地政策并舉,培育國家AI競爭力

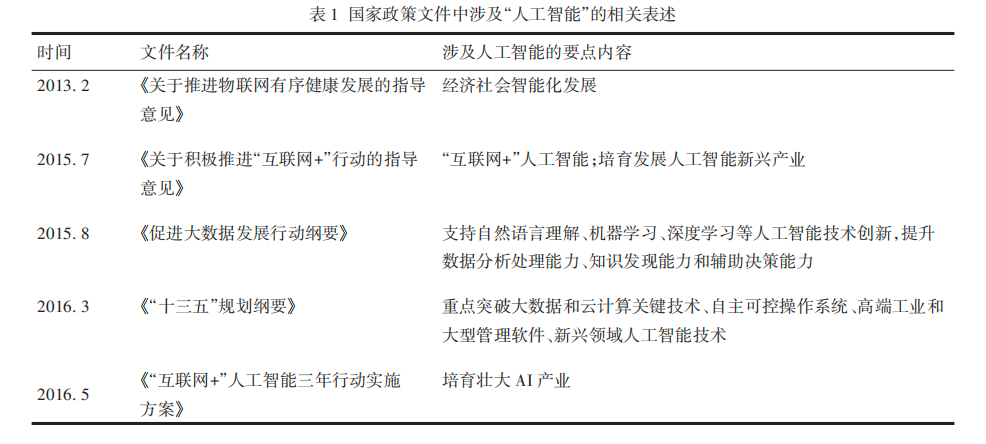

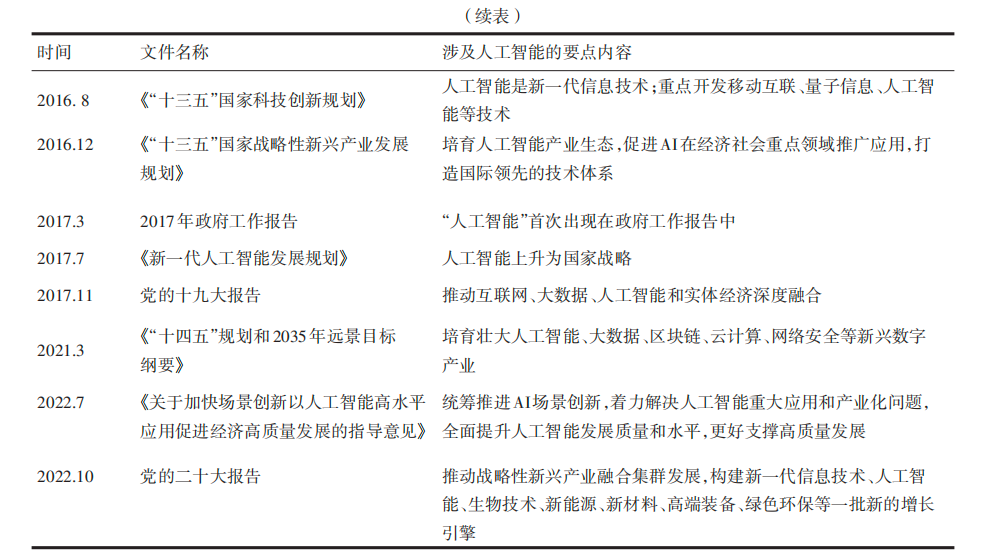

自2013年2月發布的《關于推進物聯網有序健康發展的指導意見》提出“經濟社會智能化發展”以來,AI便進入國家宏觀戰略的視野,成為國家頂層政策文件的重要議題。例如,2015年《關于積極推進“互聯網+”行動的指導意見》首次提出“培育發展人工智能新興產業”。此后,國家對AI的重視程度不斷提高,持續在戰略層面對發展AI做出部署,確保實現核心技術自主可控,推進高水平科技自立自強(表1)。

落地政策同樣重要。AI是新興技術與新興產業的綜合體,AI技術創新只有轉化為可持續的產業生態,并和實體經濟深度融合,才能發揮好其作為新的增長引擎的強大作用。在這方面,試驗區、先導區等先行先試模式發揮著重要作用。科技部著力推進的人工智能創新發展試驗區建設成果顯著,全國已經批復建設18個國家新一代人工智能創新發展試驗區,在政策工具、應用模式、經驗做法等方面起到了很好的引領帶動作用。2019年至今,工信部批復建設11個國家人工智能創新應用先導區,促進AI和實體經濟深度融合;2022年7月,科技部等六部門發布《關于加快場景創新以人工智能高水平應用促進經濟高質量發展的指導意見》,著力解決AI應用和產業化問題,以“數據底座+算力平臺+場景開放”三駕馬車驅動AI與經濟社會發展深度融合,更好支撐高質量發展。

在國家宏觀戰略和落地政策的持續支持下,中國AI領域的創新創業持續活躍,AI領域的國家級實驗室陸續建立,在AI領域的技術創新、產業應用、人才規模等方面均取得了重要成就。中國科學技術信息研究所發布的《2021全球人工智能創新指數報告》顯示,目前全球AI發展呈現中美兩國引領、主要國家激烈競爭的總體格局。[4]中國AI發展成效顯著,AI創新水平已經進入世界第一梯隊,與美國的差距進一步縮小。中國的超算中心、AI企業規模、專利注冊數量、人才隊伍建設和科研實力均處在全球領先行列,未來,AI對中國經濟增長和社會發展的貢獻將持續放大。普華永道的研究報告預測,全球來看,到2030年AI對全球經濟的貢獻將達到15.7萬億美元,中國將從AI中收獲最大的經濟收益,達到7萬億美元,意味著AI將推動中國GDP增長約26.1%;美國和北美其次,將達到3.7萬億美元。[5]

科技倫理制度不斷完善,成為AI創新的重要保障

在數字時代,AI等新興數字技術,具有不同于工業時代的技術應用的獨特性和復雜性。主要體現為:(1)更廣泛的聯通性,網絡的連接和數據的收集、處理無處不在;(2)更強的自主性,AI系統驅動各種產品和服務獨立運行,無須人類干預;(3)更深的不透明性,AI系統的“算法黑箱”難以被理解和解釋;[6](4)更高的擬真性,AI生成、合成的內容、數據和虛擬世界越來越逼近現實。正因如此,AI等新技術應用可能引發的社會倫理問題越來越具有突發性、隱蔽性、規模性、不可預測性等諸多特征,這給科技倫理治理提出新的挑戰。在AI的發展應用過程中,同步考慮甚至提前考慮科技倫理問題變得越來越必要和重要。[7]科技倫理制度的調整完善,由此成為AI時代的重要議題,需要從關注人的倫理轉向關注技術的倫理,實施對智能體進行道德約束,構建友善的數字社會秩序。[8]更進一步而言,隨著全球科技競爭日益激化,科技倫理不僅事關科技安全風險挑戰之防范,而且關乎國家科技競爭力之打造。

黨的十八大以來,國家對科技倫理的重視程度不斷提升,明確提出科技倫理是科技活動必須遵守的價值準則,并將科技倫理納入頂層政策設計,作為科技創新的重要支撐和保障。《中共中央關于堅持和完善中國特色社會主義制度推進國家治理體系和治理能力現代化若干重大問題的決定》和《十四五規劃和2035年遠景目標綱要》對科技倫理做出了頂層部署,要求健全科技倫理治理體制,健全科技倫理體系。目前,國家持續建立健全科技倫理制度,塑造科技向善的文化理念和保障機制。主要體現在以下三個方面:

第一,組建國家科技倫理委員會,負責指導和統籌協調推進全國科技倫理治理體系建設工作。2019年7月,中央全面深化改革委員會第九次會議審議通過了《國家科技倫理委員會組建方案》,正式確立了中國國家級的科技倫理管理機構。2022年3月發布的《關于加強科技倫理治理的意見》進一步明確了國家科技倫理委員會的管理職責。

第二,出臺科技倫理相關的政策法規,支持科技倫理治理落地實施。2021年12月修訂的《科學技術進步法》的一大亮點就是增加了科技倫理相關條款,一方面對健全科技倫理治理體制做出了整體規定,另一方面要求科學技術研究開發機構、高等學校、企業事業單位等主體履行科技倫理管理主體責任,對科學技術活動開展倫理審查,同時明確科學技術研究開發和應用活動的法律倫理底線。《關于加強科技倫理治理的意見》則對科技倫理治理提出了更為全面的要求,涉及總體要求、原則、體制、制度保障、審查和監管以及教育和宣傳六大方面,為科技倫理治理的落地實施奠定了基礎。后續還將制定科技倫理審查辦法、科技倫理高風險科技活動清單、細分領域的科技倫理規范等配套規定。

第三,強調AI領域的科技倫理治理。國家新一代人工智能治理專業委員會先后發布《新一代人工智能治理原則——發展負責任的人工智能》和《新一代人工智能倫理規范》,為發展負責任的AI提供倫理指南。《數據安全法》《互聯網信息服務算法推薦管理規定》《關于加強互聯網信息服務算法綜合治理的指導意見》等法律法規,對數據和算法活動提出科技倫理要求和管理措施。《關于加強科技倫理治理的意見》將AI、生命科學、醫學作為“十四五”期間的三個重點領域,要求制定專門的科技倫理規范、指南等,加強科技倫理立法,并要求相關行業主管部門推出科技倫理監管舉措。可以預見,未來AI領域的科技倫理監管將得到加強。此外,地方層面的立法如《深圳人工智能產業促進條例》和《上海促進人工智能產業發展條例》都把AI倫理治理作為支持AI產業健康發展的重要保障。

從以上分析可以看出,目前在AI的科技倫理治理方面,一個顯著的趨勢是把創新主體的科技倫理管理主體責任作為一個主要的抓手,這和互聯網平臺監管強調平臺主體責任具有一定的相似性。政府對平臺的監管,在很大程度上是通過落實、壓實平臺主體責任來實現的,網絡領域的相關立法構建了事前、事中、事后全方位的平臺義務體系,市場監管總局發布的《互聯網平臺落實主體責任指南(征求意見稿)》嘗試對不同類型的平臺的主體責任進行細化。政府對AI的監管,呈現出類似的思路。目前的相關政策法規嘗試對科技倫理管理主體責任進行細化,要求創新主體建立倫理委員會、堅持科技倫理底線、進行科技倫理審查、開展科技倫理風險監測預警和評估、開展科技倫理培訓等。

互聯網領域算法應用成為AI監管的重點對象

算法推薦、算法自動化決策、AI深度合成等互聯網領域的算法應用,由于應用廣泛、社會公眾關注度高、負面問題持續凸顯等因素,成為政府在AI領域重點監管的對象。近年來,國家出臺了一系列法律法規,積極規范互聯網領域算法應用。[9]國家互聯網信息辦公室等九部門出臺的《關于加強互聯網信息服務算法綜合治理的指導意見》提出了較為全面的管理要求,希望利用三年左右時間,逐步建立治理機制健全、監管體系完善、算法生態規范的算法安全綜合治理格局。該意見同樣強調強化企業主體責任,包括算法安全責任、科技倫理審查等。

在算法推薦方面,《網絡信息內容生態治理規定》提出針對算法推薦技術健全人工干預和用戶自主選擇機制。2022年3月1日起施行的《互聯網信息服務算法推薦管理規定》則是中國第一部聚焦算法治理的立法,該規定針對算法推薦服務提供者提出全方位的義務和禁止性要求,提出算法安全風險監測、算法安全評估、算法備案管理等一系列監管舉措,進一步強化平臺企業的算法安全責任。業內人士以此為標志,將2022年稱為算法監管元年。

在算法自動化決策方面,《中華人民共和國個人信息保護法》《中華人民共和國電子商務法》《在線旅游經營管理服務暫行規定》等都有相關條款對算法歧視、大數據殺熟等不公平、不正當的算法決策行為進行規制,提出了向個人提供選擇權限、開展影響評估、個人可以要求說明和享有拒絕權限等規制方式,更好地平衡個人權益保護和算法商業應用活動。

在AI深度合成(主要是指利用AI技術生成、合成信息內容)方面,相關立法積極為AI深度合成技術劃定應用紅線,促進技術正向應用,如《網絡音視頻信息服務管理規定》《網絡信息內容生態治理規定》《互聯網信息服務算法推薦管理規定》等都禁止將深度合成算法用于虛假新聞信息和其他違法違規活動。2022年11月通過的《互聯網信息服務深度合成管理規定》,總結既往監管經驗,從深度合成服務提供者主體責任、深度合成信息內容標識管理等方面,對深度合成技術應用進行全面規范,通過內容標識、檢測識別、內容溯源等必要的安全保障措施確保深度合成技術應用安全可靠,更好地促進技術創新發展和積極正向應用。

整體而言,互聯網領域的算法監管強調安全可控、權益保護、公平公正、公開透明、濫用防范等多元目的,在算法應用分級分類基礎上,重點規制高風險類算法應用。算法分級分類監管和《歐盟人工智能法案》對AI系統的監管思路是類似的,后者按照不可接受風險、高風險、有限風險、最小風險對AI系統進行分級,并對不同風險程度的AI系統提出不同的監管要求。在此背景下,學界對算法治理的研究興趣濃厚,提出了算法解釋、算法影響評估、算法審計等諸多思路。未來,各界還需進一步探索完善算法監管的方式方法和治理舉措,更好地保障算法應用向上、向善。

以監管創新促進AI在傳統強監管領域應用落地

對于交通、醫療等傳統強監管領域而言,自動駕駛汽車、載人無人機(無人駕駛的飛行汽車)、AI醫療軟件等新生事物面臨的主要問題是,其商業化應用仍面臨較大的法律和監管障礙。這些障礙不僅影響消費者和公眾對技術的信任,而且打擊創新者和投資者的積極性。因此,有效的監管創新是這些新事物發展應用的關鍵所在。以自動駕駛汽車為例,只有加快革新旨在規制傳統汽車和人類司機的立法和監管框架,進而建立新的、有效的監管框架,才能加快實現自動駕駛汽車的商業化應用。

中國的政策制定者積極創新監管方式和手段,通過“監管沙盒”(Regulatory Sandbox,詳見后文介紹)、試點、示范應用等方式支持、促進AI新事物應用落地。在自動駕駛汽車領域,國家出臺了一系列立法和規范性文件,鼓勵、支持和規范自動駕駛汽車道路測試與示范應用活動,探索自動駕駛汽車安全標準的“監管沙盒”,完善自動駕駛汽車準入和上路通行規則,保障自動駕駛汽車運輸安全。由于監管政策利好,北上廣深等各地紛紛搶占發展高地,部分城市已向自動駕駛廠商發放了允許車內無駕駛人、可以收費運營的無人駕駛汽車試運營牌照;深圳則在全國率先出臺《深圳智能網聯汽車管理條例》,為商業化應用奠定立法和監管框架。在AI醫療領域,由于AI醫療軟件具有不同于傳統醫療器械的諸多全新特征,包括自主性、學習進化能力、持續迭代性、算法黑箱、不可預測性等,這使得傳統審批程序難以有效適應AI醫療軟件的發展需求。為此,監管部門積極完善AI醫療器械的注冊申報和審批程序、使用管理規范,支持智能醫學影像等輔助診斷和輔助治療的AI醫療軟件加快臨床應用;目前國內已有AI醫療軟件獲得審批,如騰訊覓影的AI輔助診斷青光眼軟件、肺炎AI輔助診斷系統都已獲批第三類醫療器械注冊證(“三類證”)。未來,監管部門還需持續完善、優化針對AI醫療軟件的注冊申報和審批程序,讓AI醫療應用更好地增進民生福祉。

加快探索AI的知識產權保護規則

AI生成內容(AI-Generated Contents,縮寫AIGC)已經成為AI的新疆域,代表著AI的未來發展方向[10]。在互聯網領域,AIGC是PGC(專業生產內容)和UGC(用戶生產內容)之后的內容生產形態,帶來自動化內容生產的巨大變革。目前,AIGC技術已能自主生產多種形式的內容,包括文本、圖片、音頻、視頻、3D內容(3D物品、3D虛擬場景)等。AIGC技術及其應用的知識產權保護規則由此成為繞不過去的重要議題,諸如“AIGC內容的著作權保護及歸屬如何確立”“AIGC技術使用他人版權內容是否侵權”等都是亟待解決的問題。[11]國外有學者提出,需要建立專門的AI知識產權保護規則和國際條約,因為AI技術打破了創作者和發明人只能是人類的既有模式。

國內外已在積極探索AI生成內容的知識產權保護規則。在國外,英國、歐盟、日本、南非等在考慮或者已經制定了專門的AI知識產權保護規則,如英國《版權、設計與專利法》中的計算機生成作品保護條款、歐盟《單一數字市場版權指令》中的基于AI技術的文本與數據挖掘版權例外條款等。在專利方面,英國的政策指出,由于AI還沒有先進到可以獨立自主地進行發明創造,所以當前還沒必要對專利法進行修改,但需密切關注技術進展并及時評估AI的專利問題。

在國內,北京菲林律師事務所訴百度“百家號”著作權侵權案中,法院雖然認為只有自然人創作完成的獨創性作品才可獲得版權保護,由此否定了AI直接且獨立生成的作品的版權保護可能性,但卻指出可以通過競爭法等方式對AI生成內容的相關權益(如競爭性權益)進行保護。深圳市騰訊計算機系統有限公司訴上海盈訊科技有限公司侵害著作權及不正當競爭糾紛案中,法院基于AI領域的人機協作現實,指出AI寫稿軟件Dream writer在技術上“生成”作品只是創作過程的一個環節,原告主持的多團隊、多人分工形成的整體智力活動才是創作的核心環節,并由此認定涉案文章是原告主持的法人作品。關于Dream writer案的認定更符合當前AIGC技術及其應用的發展狀況,對將來通過立法進一步明確AI生成內容的知識產權保護規則具有較大的借鑒意義。在立法上,2020年新修訂的《中華人民共和國著作權法》采用開放性的作品認定方式,在明確作品構成要件、列舉主要作品類型的同時,規定了開放式的兜底條款,為AIGC等新技術應用帶來的新客體保護預留出制度空間。

標準化建設是AI治理的關鍵一環

《國家標準化發展綱要》指出,標準化在推進國家治理體系和治理能力現代化中發揮著基礎性、引領性作用。對于AI領域而言,AI標準不僅是支持、促進AI發展進步和廣泛應用的重要手段(如技術標準),而且是推進落實AI治理的有效方式(如治理標準、倫理標準),因為AI治理標準可以起到“承接立法和監管、對接技術實踐”的重要作用。再者,AI治理領域的標準相比立法和監管更具敏捷性、靈活性和適應性。因此,AI治理標準已經成為AI技術和產業發展中的一個制高點,國際社會紛紛提出落地舉措。典型代表有歐盟的可信AI標準,美國國家標準與技術研究院(NIST)主導的AI風險管理、AI歧視識別等治理標準,英國的AI認證生態系統發展規劃,IEEE的AI倫理標準等。在落地方面,IEEE已面向行業推出了AI倫理認證項目;英國希望通過5年時間培育一個世界領先、價值數十億英鎊規模的AI認證行業,通過中立第三方的AI認證服務(包括審計、影響評估、認證)來評估、交流AI系統的可信性和合規性。

中國非常重視AI領域的標準化建設,《國家標準化發展綱要》要求在AI、量子信息、生物技術等領域,開展標準化研究。近年來,各界持續推進AI治理領域的國家標準、行業標準、地方標準、團體標準等標準化工作。例如,國家標準化管理委員會成立國家人工智能標準化總體組,全國信息技術標準化技術委員會設立人工智能分技術委員會,都旨在推進制定AI領域的國家標準。2020年7月印發的《國家新一代人工智能標準體系建設指南》明確了AI標準領域的頂層設計,該指南將安全/倫理標準作為AI標準體系的核心組成部分,旨在通過安全/倫理標準為AI建立合規體系,促進AI健康、可持續發展。未來,AI治理相關標準需加快制定并落地實施,從而為AI領域的技術創新和產業發展提供更多保障。

行業主動探索AI治理的自律措施,踐行負責任創新和科技向善理念

有效的AI治理需要政府、企業、行業組織、學術團體、用戶或消費者、社會公眾等多元主體的共同參與,其中,科技企業的自我治理和自律管理是落實“倫理先行”理念的重要方式。之所以呼吁“倫理先行”,在很大程度上是因為面對AI的快速發展,“法律的滯后性”現象變得越來越突出。在AI領域,“倫理先行”首先表現為科技企業的科技倫理自律管理,而且領先企業的最佳實踐做法往往能夠起到很好的引領帶動作用,推動整個行業踐行負責任創新和科技向善理念。

在行業層面,近年來,相關研究機構和行業組織紛紛提出AI的倫理指南、自律公約等,為企業的AI活動提供倫理指引。這方面的典型代表有中國人工智能產業發展聯盟(AIIA)的《人工智能行業自律公約》和《可信AI操作指引》、北京智源人工智能研究院的《人工智能北京共識》和《人工智能產業擔當宣言》、全國信息安全標準化委員會的《網絡安全標準實踐指南——人工智能倫理安全風險防范指引》等。

在企業層面,科技企業作為AI技術創新和產業應用的主體,擔負著負責任地研發應用AI的重要責任。在國外,從提出AI倫理原則,到成立內部的AI倫理治理機構,再到開發管理和技術工具甚至商業性的負責任AI解決方案,科技公司探索出了較為成熟的經驗,積累了很多可資推廣的實踐做法(表2)[13]。近年來,國內科技公司積極落實監管要求,探索相關自律措施,主要包括:發布AI倫理原則,建立內部的AI治理組織(如倫理委員會),針對AI活動開展倫理審查或安全風險評估,對外披露算法相關信息、促進算法公開透明,探索應對AI倫理問題的技術解決方案(如針對合成信息內容的檢測識別工具、AI治理測評工具、聯邦學習等隱私計算方案),等等。